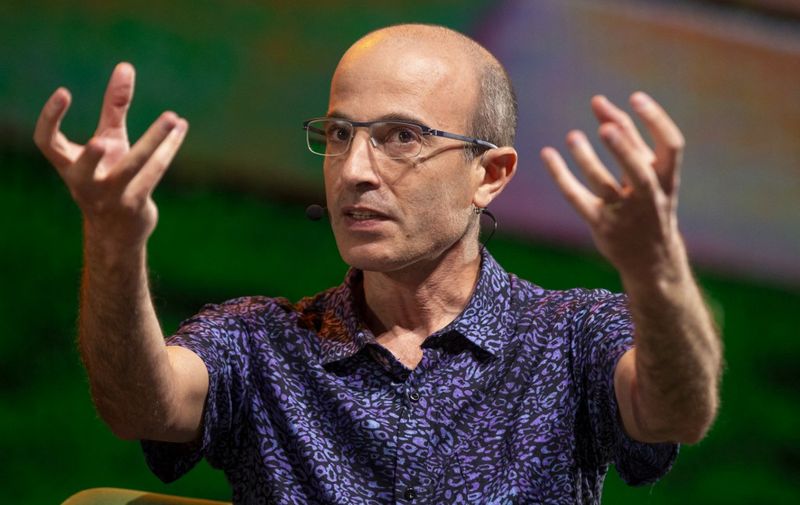

Intelektualac Yuval Noah Harari silno je zabrinut: 'Umjetna inteligencija doista prijeti ljudskom opstanku, i to kroz financijski sektor'

Kod umjetne inteligencije teško je predvidjeti sve potencijalne opasnosti i probleme, kaže

Izraelski povjesničar, intelektualac i autor bestselera Sapiens: Kratka povijest čovječanstva, Yuval Noah Harari, smatra da bi umjetna inteligencija (AI) mogla uzrokovati financijsku krizu s “katastrofalnim” posljedicama. Sofisticiranost takve tehnologije, kako kaže za Guardian, otežava predviđanje opasnosti koje ona nosi.

Za razliku od nuklearnog oružja, u slučaju AI-ja ne postoji “veliki, opasni scenarij” koji svi razumiju, dodaje.

“Kod AI-ja, spominje se veliki broj mogućih opasnih scenarija, a svaki od njih ima relativno malu vjerojatnost što, kada se sve zbroji, predstavlja prijetnju opstanku ljudske civilizacije”, smatra Harari.

‘Važna je globalna suradnja’

Popularni autor, koji je i ranije izražavao zabrinutost zbog razvoja AI-ja, smatra da je globalna konferencija o umjetnoj inteligenciji, koja se prošlog tjedna održala u Bletchley Parku, “jako važan korak naprijed” jer su se vodeće vlade okupile kako bi izrazile zabrinutost oko tehnologije i učinile nešto po tom pitanju.

“Možda je ono što najviše ohrabruje ili daje nadu to što bi mogli pridobiti ne samo Europsku uniju, Ujedinjeno Kraljevstvo, Sjedinjene Države, nego i vladu Kine, da potpiše deklaraciju. Mislim da je to bio vrlo pozitivan znak. Bez globalne suradnje bit će iznimno teško, ako ne i nemoguće, obuzdati najopasniji potencijal umjetne inteligencije”, kazao je.

Summit je zaključen sporazumom između deset vlada i velikih AI tvrtki – uključujući OpenAI koja je razvila ChatGPT – o suradnji na testiranju naprednih AI modela prije i nakon njihova puštanja u javnost. Dakle, dogovoreno je da treba uspostaviti zajednički pristup nadzoru umjetne inteligencije.

‘Teško je predvidjeti sve opasnosti’

Harari ističe da je problem sa sigurnosnim testiranjem modela AI-ja predviđanje svih problema koje moćan sustav može izazvati.

“AI se razlikuje od svih prethodnih tehnologija u ljudskoj povijesti jer je to prva tehnologija koja može sama donositi odluke, koja može sama stvarati nove ideje i koja može sama učiti i razvijati se. Gotovo po definiciji je iznimno teško, čak i onima koji su stvorili tehnologiju, predvidjeti sve potencijalne opasnosti i probleme.”

Harari ističe financije kao sektor koji je idealan za sustave umjetne inteligencije, a time i potencijalni izvor ozbiljne krize. “Što se događa ako AI, ne samo da dobije veću kontrolu nad financijskim sustavom svijeta, nego počne stvarati nove financijske instrumente koje samo AI može razumjeti, koje nijedno ljudsko biće ne može razumjeti?”, pita se Harari.

‘Samo zamislite tu situaciju’

Dodaje kako su financijsku krizu 2007.-2008. uzrokovali dužnički instrumenti kao što su kolateralizirane dužničke obveze (CDO), koje je, kaže, malo ljudi razumjelo.

“AI ima potencijal za stvaranje financijskih instrumenata koji su puno složeniji od CDO-a. I samo zamislite situaciju u kojoj imamo financijski sustav koji nijedno ljudsko biće nije u stanju razumjeti i stoga ga nije u stanju regulirati. Onda dođe do financijske krize i nitko ne razumije što se događa.”

No, Harari kaže da financijska kriza koju bi stvorila umjetna inteligencija neće uništiti ljudsku civilizaciju, “bar ne izravno”. “Mogla bi, neizravno, ako izazove određene vrste ratova ili sukoba. To je katastrofalan rizik – ekonomski, društveni, politički – ali samog po sebi ne bih ga opisao kao egzistencijalni.”

‘Važno je reagirati na vrijeme’

Smatra da je potrebno “čim prije” stvoriti moćne regulatorne institucije koje su u stanju “prepoznati i reagirati na opasnosti kako se one pojavljuju” – umjesto “kompliciranih propisa” koji bi do trenutka kada budu odobreni u parlamentima već bili zastarjeli.

Dodaje i da bi instituti za sigurnost umjetne inteligencije trebali angažirati stručnjake koji razumiju potencijalni utjecaj AI-ja na svijet financija.